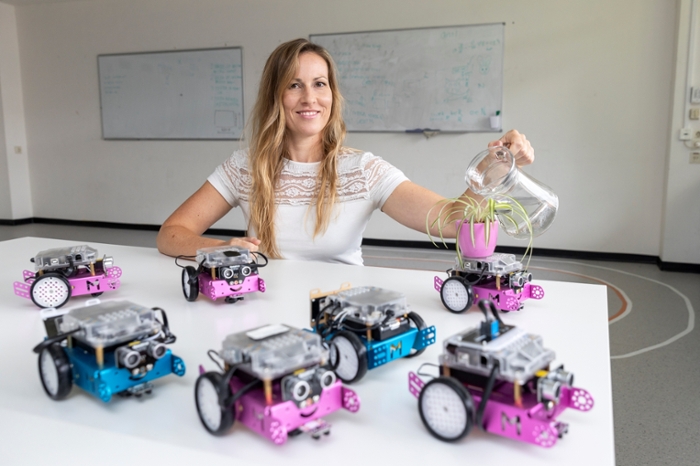

Tessa Verhoef: 'Een algoritme kan nog veel leren van interactie tussen mensen'

Als een algoritme taal moet leren begrijpen, heeft het niets aan 'alleen maar' veel data. De computer moet het, net als wijzelf, leren in interactie met anderen. Hoe die interactie werkt, interesseert Tessa Verhoef mateloos.

Met zo'n zestig medestudenten begon Verhoef in 2003 aan de studie Kunstmatige intelligentie in Groningen. Ze was een voorloper, later rezen de studentaantallen de pan uit. 'Ik raakte tijdens mijn studie gefascineerd door taalevolutie en culturele evolutie: hoe taal en verhalen veranderen doordat mensen ze aan elkaar doorgeven.'

Verhoef experimenteerde met mensen die zonder woorden, maar spontaan communicerend met een trekfluitje, een heel nieuw soort taal moesten leren en doorgeven aan anderen. De inzichten daaruit neemt ze mee naar AI-systemen om ze te helpen bij natural language processing. Op die manier kan tussen machines ook op een natuurlijkere manier een communicatiesysteem ontstaan.

'Door het na te bouwen met machines, leren we hoe het werkt in mensen'

'Door die evolutieprocessen na te bouwen met machines kunnen we ook weer veel leren over hoe het precies werkt in menselijke interactie. Bovendien, als zulke interactie ook tussen mens en machine kan ontstaan, kunnen we ook effectiever samen taken uitvoeren. Dat ontwikkelproces wil ik onderzoeken.'

Proefpersonen staan in de rij

Verhoefs werkwijze is onconventioneel. Ze doet veel onderzoek in musea en op festivals. 'Enorm leuk, en de proefpersonen staan in de rij om mee te doen.' Ze liet op Lowlands mensen verhalen aan elkaar doorvertellen. 'Ik wilde uitzoeken welke elementen van een verhaal verloren gaan of juist versterkt worden als het een paar keer wordt doorverteld. Die kennis is belangrijk als je bijvoorbeeld een algoritme wilt leren om misinformatie te detecteren. Elementen met een shock-factor, wat mystiek of intrige hebben een grote overlevingskans en worden vaak uitvergroot of zelfs erbij verzonnen.'

Gevaarlijke onzinberichten

AI-systemen kunnen nu al sentimenten detecteren op bijvoorbeeld sociale media. Verhoef hoopt dat ze ook nepnieuws leren detecteren. 'Over corona bijvoorbeeld, verschijnen veel gevaarlijke onzin-berichten. Informatie uit een doorvertel-spel kan helpen AI-systemen te trainen in het herkennen van berichten die mogelijk niet kloppen door bijvoorbeeld de aanwezigheid van elementen die gevoelig zijn voor verandering en uitvergroting.'

Toch is een nuttig AI-systeem niet eens haar belangrijkste doel. Fundamentele interesse in sociale interactie is wat Verhoef drijft. 'Wat ik doe, is learning by building. We stoppen alle kennis die we hebben in een AI-systeem en als we dan merken dat het niet werkt, weten we dat we nog niet alles begrijpen.'

Taal begrijpen: de heilige graal

In de AI-wereld is een computer die taal kan begrijpen de heilige graal. Die graal is nog ver weg: Google of Siri begrijpen niets en je kunt geen gesprek met ze voeren. Verhoef: 'Robots worden soms ingezet als sociaal maatje en dat kunnen ze in potentie zeker zijn. Programmeren alleen volstaat dan niet. Taal is sterk afhankelijk van sociale interactie: met je moeder praat je anders dan met een collega. De machine heeft sociale interactie met mensen nodig om een persoonlijk gesprek te kunnen voeren.' Artificiële intelligentie schuift steeds meer op naar hybride intelligentie: intelligentie van mens en machine samen.

Tekst: Rianne Lindhout

Foto: Patricia Nauta